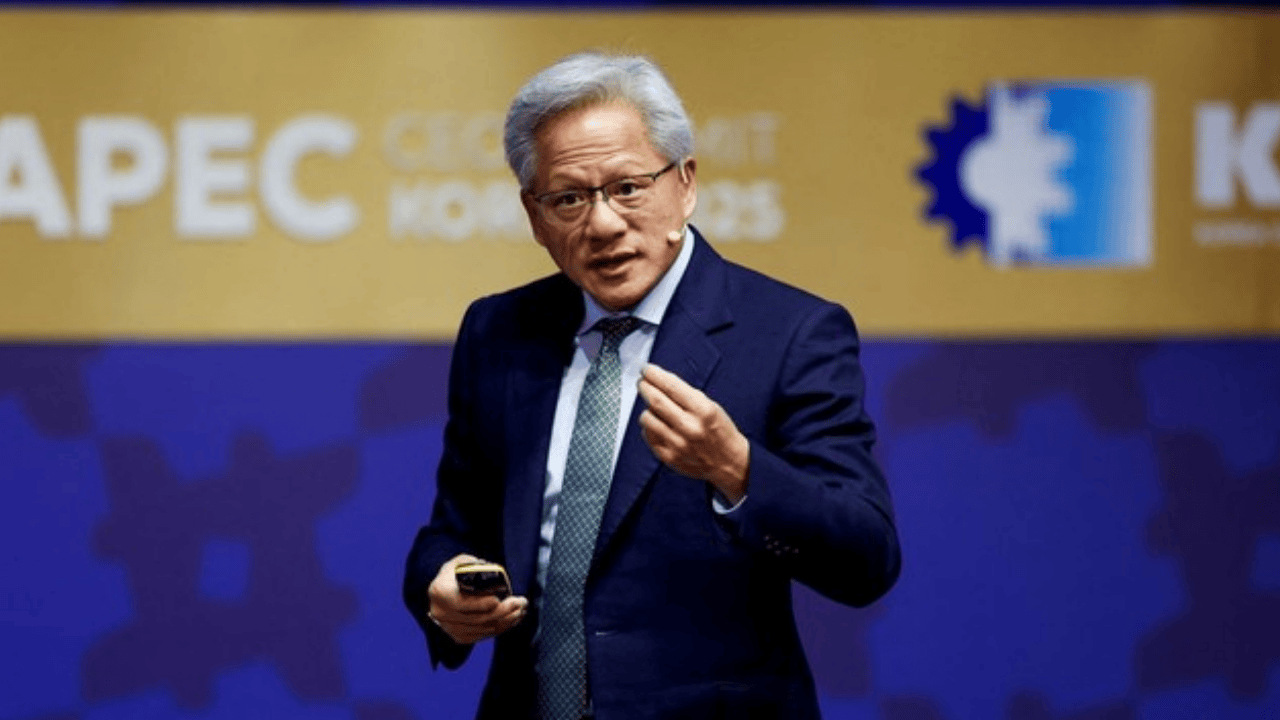

Perspektif.co.id - CEO Nvidia Jensen Huang mengumumkan generasi terbaru chip buatan perusahaannya kini memasuki fase “produksi penuh”, menandai kesiapan raksasa semikonduktor itu mengejar lonjakan permintaan komputasi berperforma tinggi, terutama untuk kebutuhan kecerdasan buatan (AI) dan pusat data. Pernyataan itu disampaikan Huang saat tampil di panggung Consumer Electronics Show (CES) 2026 di Las Vegas, Amerika Serikat, pada Senin (5/1/2026).

Dalam pemaparan tersebut, Huang menyebut chip generasi baru Nvidia mampu memberikan daya komputasi AI hingga lima kali lipat dibanding chip sebelumnya ketika dipakai untuk melayani chatbot dan berbagai aplikasi AI lain. Klaim ini menjadi sinyal bahwa Nvidia ingin mempertegas dominasinya di pasar akselerator AI, sekaligus merespons kompetisi yang kian ketat dari pesaing tradisional dan bahkan dari pelanggan besar yang mulai mengembangkan chip mereka sendiri.

Menurut laporan Reuters, eksekutif Nvidia menyampaikan chip terbaru itu sudah berada di laboratorium perusahaan dan sedang diuji oleh perusahaan-perusahaan AI, menjelang pengiriman komersial yang ditargetkan tiba “akhir tahun ini”. Dalam pidatonya, Huang juga mengungkap detail platform baru yang disebut Vera Rubin, yang disusun dari enam chip Nvidia terpisah dan dirancang sebagai tulang punggung generasi berikutnya dari infrastruktur AI skala besar.

Platform Vera Rubin diproyeksikan debut pada 2026 dengan konfigurasi server andalan yang berisi 72 unit GPU dan 36 prosesor pusat (CPU) baru. Nvidia menjelaskan sistem ini dapat dirangkai menjadi “pod” yang memuat lebih dari 1.000 chip Rubin, sehingga cocok untuk kebutuhan pusat data raksasa yang mengejar efisiensi tinggi dalam melayani model AI berskala masif. Huang mengeklaim arsitektur pod tersebut dapat meningkatkan efisiensi dalam menghasilkan “token”—unit dasar yang diproses sistem AI—hingga 10 kali lipat.

Namun, untuk mengejar lompatan performa itu, Nvidia mengandalkan format data khusus yang bersifat proprietary dan didorong agar bisa diadopsi lebih luas oleh industri. “Ini adalah cara kami bisa memberikan lompatan performa yang sangat besar, meskipun jumlah transistornya hanya 1,6 kali lipat,” ujar Huang.

Langkah Nvidia ini terjadi ketika perlombaan AI tidak lagi sebatas melatih model, tetapi juga menyalurkan hasil model tersebut kepada ratusan juta pengguna—misalnya lewat chatbot dan layanan AI lain—yang menuntut biaya lebih efisien dan respons lebih cepat. Reuters menulis, meski Nvidia masih mendominasi pasar pelatihan model AI, tekanan persaingan meningkat dari perusahaan seperti Advanced Micro Devices (AMD) serta pelanggan seperti Google (Alphabet) yang memperkuat chip internal mereka untuk mengurangi ketergantungan pada Nvidia.

Karena itu, fokus pidato Huang banyak mengarah pada kemampuan chip baru untuk kebutuhan inferensi—yakni fase ketika model AI dipakai melayani pengguna—bukan sekadar pelatihan. Nvidia menambahkan lapisan teknologi penyimpanan baru yang disebut “context memory storage”, yang ditujukan agar chatbot bisa memberi respons lebih cepat pada pertanyaan panjang dan percakapan yang berlapis.

Di area jaringan pusat data, Nvidia juga mempromosikan generasi baru switch yang membawa koneksi “co-packaged optics”. Teknologi ini diposisikan krusial untuk menghubungkan ribuan mesin agar bertindak sebagai satu sistem komputasi besar. Di saat yang sama, fitur tersebut menjadi bagian dari pertarungan Nvidia melawan pemain jaringan mapan seperti Broadcom dan Cisco Systems di wilayah infrastruktur data center.

Dari sisi adopsi pelanggan, Nvidia menyebut CoreWeave bakal menjadi salah satu pengguna awal sistem Vera Rubin. Nvidia juga memperkirakan perusahaan-perusahaan besar seperti Microsoft, Oracle, Amazon, dan Alphabet akan mengadopsi sistem Rubin untuk kebutuhan komputasi AI mereka.

Di luar chip, Nvidia juga membawa pengumuman terkait perangkat lunak kendaraan otonom. Huang menyoroti software bernama Alpamayo yang dirancang membantu mobil otonom menentukan jalur dan meninggalkan “jejak dokumen” yang bisa ditelusuri insinyur setelahnya. Nvidia sebelumnya mempresentasikan riset Alpamayo pada akhir 2025, dan kini Huang menyatakan perangkat lunak tersebut akan dirilis lebih luas bersama data pelatihan agar produsen mobil bisa melakukan evaluasi. “Bukan hanya kami open-source model-modelnya, kami juga open-source data yang kami gunakan untuk melatih model-model itu, karena hanya dengan cara itu Anda benar-benar bisa percaya bagaimana model-model tersebut dikembangkan,” kata Huang dari panggung Las Vegas.

Pada saat yang sama, Nvidia juga tengah memperkuat posisinya melalui akuisisi talenta dan teknologi. Reuters melaporkan bahwa pada bulan sebelumnya, Nvidia “menggaet” talenta serta teknologi chip dari startup Groq, termasuk eksekutif yang sebelumnya berperan penting membantu Google merancang chip AI internalnya. Huang menegaskan akuisisi tersebut tidak akan mengganggu bisnis inti Nvidia, namun berpotensi melahirkan produk baru yang memperluas portofolio perusahaan. “(Deal Groq) tidak akan memengaruhi bisnis inti kami,” ujar Huang dalam sesi tanya jawab dengan analis setelah pidato.

Satu isu lain yang ikut disorot adalah pasar China dan pembatasan ekspor chip berperforma tinggi. Nvidia disebut ingin menunjukkan produk terbaru mereka mampu mengungguli chip lama seperti H200. Reuters menulis H200, yang merupakan pendahulu dari chip “Blackwell” Nvidia saat ini, memiliki permintaan tinggi di China. Dalam sesi bersama analis, Huang menyampaikan permintaan H200 di China sangat kuat. Sementara itu, CFO Nvidia Colette Kress menyebut perusahaan telah mengajukan lisensi untuk mengirim chip tersebut ke China, namun masih menunggu persetujuan pemerintah AS dan pemerintah lain terkait pengiriman.

Rangkaian pengumuman ini menegaskan strategi Nvidia untuk menjaga keunggulan di era “perang komputasi AI”: mempercepat siklus produk, memaketkan chip menjadi platform data center end-to-end, sekaligus mengunci nilai tambah melalui jaringan, penyimpanan konteks untuk chatbot, dan perangkat lunak otonom. Dengan klaim performa 5 kali lipat, arsitektur pod 1.000+ chip, serta peningkatan efisiensi token hingga 10 kali, Nvidia mengirim sinyal kuat bahwa 2026 bakal menjadi tahun krusial pertarungan infrastruktur AI global—di tengah tekanan dari AMD, chip internal raksasa teknologi, hingga dinamika regulasi ekspor.